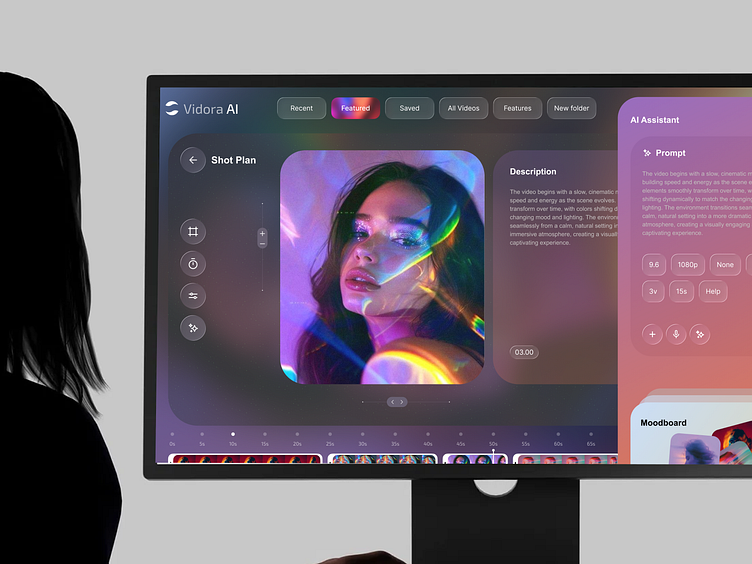

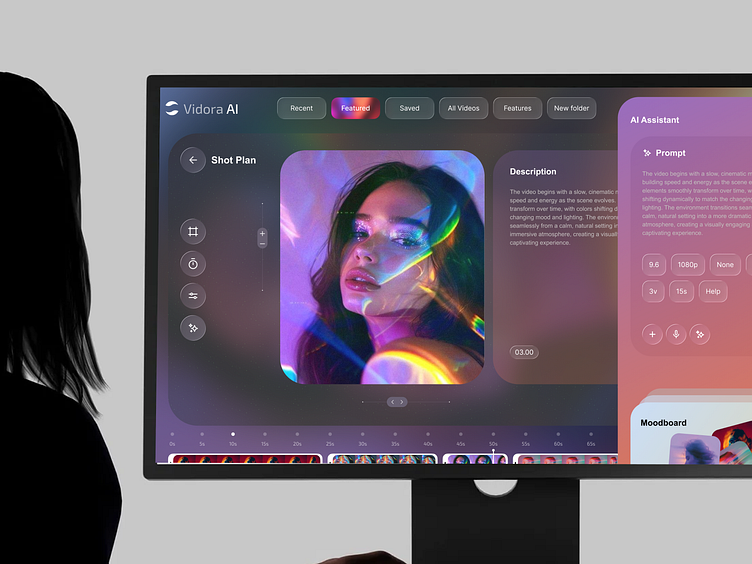

AI视频时长限制:每个模型能生成多长?

如果你正在比较AI视频生成工具的时长限制(秒),真正的问题不仅仅是哪个模型最好,而是你通过一次生成实际能获得多少可用的素材。

AI视频生成时长限制(秒):读者首先需要了解的快速比较

当前AI视频工具的典型片段长度

目前,大多数AI视频生成器仍然处于一个相当狭窄的范围:每次生成大约5到20秒。这是一种反复出现的实际行业模式,无论你是在测试成熟的商业工具,还是在自己的设备上尝试开源AI视频生成模型。如果你曾希望大多数平台能秘密地为创作者提供一键生成60秒电影级片段的功能,那并不是当前生成工具能可靠做到的。

很多困惑始于营销页面展示的“长视频”成果,这些成果实际上是由多个短片段拼接而成的。在日常使用中,你会发现工具主要集中在三个常见的范围:大约5秒、大约8秒,以及大约10到15秒,少数平台在特定模式下声称可达20秒。即便如此,最大长度和可靠长度也不是一回事。一个工具可能在技术上输出一个15秒的文件,但最后几秒可能会出现漂移、细节模糊或角色连续性中断。

“生成时长”在实践中真正意味着什么

当人们谈论AI视频生成时长限制(秒)时,他们常常混淆两个不同的概念:单次生成上限和最终视频总长度。在选择工具或支付订阅费用时,这种区别非常重要。模型的单次生成上限是它在一次处理中可以渲染的最长连续片段。然而,如果你在剪辑中将多个片段串联起来,你的最终成品视频可以长得多。

许多AI视频生成器仍然生成5-20秒范围内的短片段,这仍然是市场上的普遍模式。一些订阅服务甚至更严格,在付费计划中将生成上限设为10或15秒。这就是为什么付费访问并不自动意味着长篇生成。实际上,你通常支付的是更好的质量、更快的周转时间或更多的生成次数,而不一定是显著更长的镜头。

与Google/Gemini相关讨论中提到的8秒上限已成为人们遇到的最清晰的实际基准之一。如果你正在比较产品和工作流程,这个8秒的限制值得作为一个实用的参考点,因为它在实际用户讨论中经常出现。它也有助于校准预期:如果一个主要平台在这个时长范围内运行,那么短生成并不是你的工作流程有问题的迹象。它们仍然是正常的。

所以有用的问题不是“这个平台能制作1分钟的视频吗?”有用的问题是“我每次渲染能获得多少干净、可编辑的秒数?”如果一个模型给你8秒稳定的内容,而另一个模型给你15秒但在第6秒后出现明显故障,那么较短的模型实际上可能提供更大的价值。在比较高级工具、图像转视频开源模型项目,甚至是像HappyHorse 1.0 AI视频生成模型开源Transformer实验这样的利基系统之前,请记住这个框架。

每个模型能生成多长?一份实用的模型范围指南

5秒模型和短片优先的工作流程

第一个类别是短片优先组:这些工具通常被认为默认生成约5秒的视频。当平台针对快速概念镜头、循环式视觉效果、风格化运动或快速迭代进行优化时,这个范围很常见。Midjourney相关的讨论就是一个很好的例子,用户通常默认提及约5秒的输出,根据模式或工作流程,最高可达约20秒。

这听起来很受限,直到你以正确的方式使用这些工具。一个5秒的片段足以用于产品特写、戏剧性切入、超现实插入,或音乐视频风格剪辑中的过渡元素。诀窍是停止期待一个完整的场景,并开始将每次生成视为一个镜头。如果你使用实验性的开源Transformer视频模型在本地运行AI视频模型,你通常会陷入这种短镜头思维模式,因为内存限制、推理速度和一致性都会促使你制作更小的片段。

读者常比较的8秒模型

第二个类别是8秒范围,这在Google和Gemini相关的对话中不断出现。这可能是市场上最清晰的比较点,因为人们反复询问为什么生成会停在那里。这个上限并非随机。它反映了当前系统在连续性问题开始更严重堆积之前,仍能相当好地保持一致的点。

对于许多工作流程来说,8秒实际上是一个有用的中间地带。它足够长,可以完成一个完整的运动节拍:一次镜头推近、一个主体转身、一个短暂的动作瞬间、一个揭示,或一个简单的情感反应。如果你的镜头规划很强,8秒会感觉很充裕。如果你的提示模糊或信息过载,8秒可能仍然太长,因为模型会开始即兴创作你不需要的细节。

这也是广告宣传的工作流程可能变得模糊的地方。许多“制作长AI视频”的教程实际上是在教你如何将重复的8秒生成组合成更长的内容。这种工作流程是有效且有用的,但这与单次通过的长连续镜头不同。

10到20秒的工具和最大长度声明

第三个类别是10到20秒组,这听起来像是一个梦想的类别,直到你在压力下测试它。一些订阅工具即使在付费计划中也将输出上限设为10或15秒,而其他工具或模式则被讨论为可以延伸到20秒。从纸面上看,这似乎比5或8秒有了重大升级。在实践中,问题是整个片段是否能保持连贯。

在这里,现实主义比营销语言更重要。声称20秒的最大长度并不意味着你会经常获得20秒你想要保留的素材。运动伪影、身份漂移、不稳定的手、滑动物体和奇怪的背景扭曲通常会随着镜头的持续而变得更加明显。你可能仍然更喜欢用于风景、抽象运动或低细节B-roll的更长上限工具,但对于以角色为主的场景,干净的部分可能在文件结束前就已结束。

因此,根据实际输出范围而非标题承诺来对工具进行分组:大约5秒、大约8秒和大约10-20秒。然后测试可用时长,而不仅仅是总时长。这个标准适用于你购买高级订阅、比较图像转视频开源模型,或者检查开源AI模型商业使用许可是否对你的制作计划有影响。

为什么AI视频生成时长限制(秒)仍然如此之短

帧一致性是瓶颈

片段限制仍然很短的最大原因很简单:一致性很快就会崩溃。保持一张图像美丽很难。在角色移动、摄像机移动、物体保持原位和光线保持可信的情况下,保持数百帧连贯则要困难得多。这就是为什么AI视频生成时长限制(秒)的上限仍然低于大多数创作者的期望。

一个有用的思考方式是帧数。一个8秒的视频可能需要240多张图像或帧的连贯生成。这些帧中的每一帧都必须在脸型、服装细节、手部位置、身体比例、背景布局和运动方向上与其他帧保持一致。如果一帧漂移太远,结果可能会看起来抖动或超现实。如果这个问题在一系列帧中重复出现,该片段就变得难以使用。

这也是为什么主体身份如此脆弱的原因。模型不仅仅是保持“一个穿红色夹克的女人”。它必须保持同一个女人,拥有相同的夹克形状、头发行为、面部比例和身体位置,随着摄像机角度和运动的变化而演变。添加道具、反射、人群或快速移动,工作量就会成倍增加。场景连续性失败的原因也相同:每多一秒,模型就有更多机会自相矛盾。

为什么更长的片段需要更多的计算和金钱

更长的片段不仅在技术上更难,生成成本也更高。更多的秒数意味着更多的帧、更大的内存压力、更长的处理时间以及更高的推理成本。这是许多平台限制输出长度的直接原因。如果提供商默认让每次生成运行更长时间,他们将为每次请求支付更多的计算费用,同时在连续性崩溃时也会收到更多来自用户的质量投诉。

这种压力也体现在定价上。创作者已经抱怨生成大量短片段很昂贵,特别是当你需要多次尝试才能得到一个满意的片段时。从平台的角度来看,将输出上限设为10或15秒有助于控制资源使用。从创作者的角度来看,这可能感觉受限,但它也加快了迭代速度。你可以测试五个短提示,了解哪些有效,然后继续前进,而不是等待一个在快结束时失败的长渲染。

实际的启示很简单:更短的片段通常意味着更高的可靠性、更少的故障和更快的迭代。如果你试图强迫模型进行长时间的连续叙事,你通常是在对抗当前技术的弱点。如果你转而围绕强大的短镜头设计你的工作流程,你可以用更少的时间获得更好看的最终视频。无论你使用的是高级平台、HappyHorse 1.0 AI视频生成模型开源Transformer设置,还是试图在有限硬件上本地运行AI视频模型,这一点都适用。

当AI视频生成时长限制(秒)太低时如何制作更长的视频

将短生成拼接成一个更长的序列

标准的解决方案仍然是最好的:生成多个短片段并将它们组装成一个更长的剪辑。这就是大多数“长AI视频”工作流程在幕后实际运作的方式。它们不是通过一个提示获得一个不间断的45秒杰作。它们是将短生成串联起来,并利用剪辑来创造连续作品的错觉。

当你以场景节拍而非巨大场景来思考时,这种方法效果最好。将你的序列分解为模块化单元:开场镜头、主体入场、特写反应、动作插入、环境切入、过渡镜头和高潮镜头。有了这种结构,一个5秒或8秒的片段就不再显得受限,因为每次生成都有明确的任务。即使是10到15秒的输出也变得更容易使用,因为它支持一个明确的时刻,而不是试图独自承载整个场景。

规划提示以使片段干净地连接

最干净的长篇工作流程通常始于三件事:剧本、视觉计划和音频计划。这听起来很简单,但它改变了一切。剧本告诉你必须发生什么。视觉计划告诉你每个短片段需要展示什么。音频计划让你通过画外音、音乐、声音设计或对话来平滑过渡,将多个生成的片段连接起来。

为了保持片段之间的连续性,每次都重复使用相同的角色细节、摄像机指令、灯光提示和环境描述。如果你的角色是“短银发年轻女子,黑色风衣,霓虹灯下的雨街,缓慢推拉镜头”,那么在所有生成中保持这些锚点一致。不要在每个提示中从头重写整个视觉身份,否则你会导致漂移。摄像机语言也一样:如果一个镜头是手持且混乱的,而下一个是平滑的俯视滑行,那么除非你事先计划好,否则这种断裂会感觉更生硬。

一个实用的工作流程是在生成任何内容之前制作一张连续性表。写下角色外观、服装、道具、场景位置、时间、灯光风格、摄像机运动和情绪。然后将这些元素复制到每个相关的提示中。如果你正在使用图像转视频开源模型,尽可能从锁定的参考帧开始。如果你正在使用开源Transformer视频模型,保存能产生稳定运动的提示变体,以便你可以重复使用它们,而不是即兴创作每个片段。

许多承诺“长AI视频”的教程实际上展示的是精巧的拼接技术。这并非作弊。这是当前真正的技艺。一旦你接受了这一点,短生成上限就变得更容易处理,因为你不再与之对抗,而是开始围绕它们进行构建。

生成的片段中实际有多少可用?

为什么剪辑师通常会大幅修剪AI素材

最大的工作流程升级之一是学会区分生成时长和可用时长。一个模型可能输出5到20秒,但一旦你仔细审查素材,你实际保留的部分可能会短得多。这就是为什么经验丰富的剪辑师会大幅修剪AI片段,而不是假设整个渲染都属于时间线。

这里一个很好的实用基准是“1.5秒规则”。一些创作者说他们从不使用AI生成的片段超过1.5秒而不进行剪辑,因为镜头在屏幕上停留的时间越长,细微的运动不一致就越容易被注意到。这并不意味着每个AI片段都必须剪得那么短。它确实意味着你应该用剪辑师的眼光,而不是生成器的乐观态度来评估片段。

干净最终视频的短镜头规则

当你审查一个生成的片段时,首先检查四件事:面部稳定性、手部动作、背景漂移和物体连续性。面部稳定性告诉你身份是否逐帧保持。手部动作能快速揭示模型隐藏的弱点,因为手指和手势在运动中经常变形。背景漂移显示墙壁、窗户、标志和地平线是否在滑动或重塑。物体连续性告诉你道具、家具、衣物褶皱或车辆是否停留在它们应该在的位置。

一个有用的习惯是从中间向外擦洗片段,而不仅仅是实时观看一次。许多生成开始时很强,中间摇晃,然后短暂恢复。如果你识别出最干净的部分,即使整个时长不可用,你仍然可以挽救一个很棒的插入镜头。这在评估AI视频生成时长限制(秒)时尤其重要,因为一个“提供”你15秒的工具可能只给你3到6秒你真正想保留的内容。

直接的建议很简单:将生成时长视为原始素材,并根据可用秒数而非最大秒数来判断工具。如果一个稳定的8秒模型能可靠地给你4到6秒的干净内容,它可能胜过一个有故障的15秒模型,后者在场景崩溃前只能给你2秒的稳定内容。这种思维方式可以节省金钱,加快剪辑速度,并使你的最终剪辑看起来更具目的性。

根据AI视频生成时长限制(秒)选择工具的最佳方式

根据用例选择,而不仅仅是最大时长

最好的工具取决于你正在制作什么。对于广告和产品宣传片,通常短而高度受控的片段就足够了,因为快速剪辑已经是这种格式的一部分。对于B-roll、风景运动和氛围插入,如果纹理和摄像机运动很强,一个5到8秒的工具可以很好地工作。对于电影插入和音乐视频剪辑,短生成通常是理想的,因为你无论如何都要根据节奏进行剪辑。对于解释性视频、教育内容或更长的编辑叙事,真正的优先事项不是一次长渲染,而是一个能让你高效生成匹配片段的工作流程。

如果你正在创建以角色为主的场景,一致性比标题时长更重要。一个稳定的8秒模型绝对可以胜过一个有故障的15秒模型。如果你正在制作抽象视觉效果、类似动态图形的序列或风格化的梦境图像,那么更长上限的工具可能值得探索,因为连续性缺陷不那么明显。如果你想要完全控制和更低的长期成本,开源AI视频生成模型可能很有吸引力,但你需要考虑硬件、设置时间以及你是否能在本地运行AI视频模型而不会遇到痛苦的渲染时间。

支付视频模型费用前要问的问题

在付费之前,并排比较四件事:单次生成长度、每个片段的成本、一致性质量以及平台为同一项目重复生成片段的便捷程度。如果重新生成便宜、参考控制强大且提示复用流畅,那么上限较低的服务仍然可能是更好的选择。还要检查工作流程是否高效支持片段拼接。如果导出、组织和扩展序列很笨拙,那么更长的上限并不会为你节省多少时间。

一份实用的清单会有帮助:

- 每次生成的实际最大秒数是多少?

- 你实际保留的平均可用秒数是多少?

- 每个片段需要多少剪辑工作?

- 跨重复生成的连续性控制有多强?

- 你能轻松重复使用参考、提示和场景设置吗?

- 平台是否支持你最常制作的剪辑类型?

- 如果是开源的,其许可条款和开源AI模型商业使用规则是什么?

- 如果是本地运行,你的设置对硬件要求有多现实?

这也是利基搜索重要的原因。如果你正在将商业工具与像HappyHorse 1.0 AI视频生成模型开源Transformer这样的东西进行比较,决定不仅仅是关于秒数。它还关乎灵活性、许可、视觉风格以及本地控制是否胜过便利性。任何开源Transformer视频模型或图像转视频开源模型也是如此:自由很棒,但前提是工作流程足够稳定,能够支持你实际交付的项目。

最明智的购买决策很少基于登陆页面上最大的时长数字。它来自于衡量可用输出、可重复性以及你将短生成片段快速转化为精美长剪辑的速度。

结论

AI视频工具正在变得越来越好,但片段长度仍然受限于同一个核心现实:随着时长的增加,一致性变得越来越困难。大多数当前系统仍然在5-20秒的范围内运行,许多付费服务保持在10或15秒,而广泛讨论的Google/Gemini 8秒基准显示了短上限仍然是多么普遍。

这就是为什么最好的比较不是哪个平台承诺最长的片段。而是哪个平台能为你提供每次生成最多的可用秒数、最少的连续性问题以及最简单的工作流程,将短输出拼接成更长的视频。如果你以这种方式判断工具,短限制就不再感觉像一个死胡同,而是感觉像你可以围绕其进行设计的东西。