文本到视频AI:其幕后工作原理

文本到视频AI从外部看起来像是魔法,但一旦你理解了从提示到视频的整个流程,它的优势和怪癖就变得更容易预测和善加利用。

什么是文本到视频AI及其重要性

文本到视频AI的简单定义

文本到视频AI是一种生成式AI,它接收自然语言提示并生成与该请求匹配的视频。这个核心定义在标准参考资料中是一致的,包括维基百科对文本到视频模型的描述,即接受文本输入并生成相关视频的系统。如果你输入“一只金毛猎犬在日落时分穿过浅海,慢动作”,模型会尝试将这句话转化为动态的视觉效果,而不是仅仅返回图像或文本。

这是狭义的定义,但实际上AI视频生成更为广泛。它可以从文本、静态图像或结构化数据生成视频,而无需任何传统拍摄。这意味着同一大类包括仅凭提示生成的电影片段、图像到视频动画、从脚本组装的幻灯片式解说,或从模板和画外音构建的品牌社交视频。了解这个更广泛的定义有助于比较工具,因为并非每个“AI视频生成器”在幕后都做着同样的工作。

文本提示如何变成视频输出

在最简单的层面上,工作流程是提示输入,视频输出。你输入一个描述,模型解释请求,生成视觉帧或潜在视觉表示,随时间添加运动,并渲染一个片段。有些产品将几乎所有这些复杂性隐藏在一个文本框后面。其他产品则暴露更多控制,如摄像机运动、风格参考、场景时间或源图像约束。

这种基本流程很重要,因为它解释了为什么工具之间的结果差异如此之大。有些系统更接近纯粹的生成模型,其中提示是主要的指令集。其他系统是在生成之上分层的流程产品,带有模板、素材库、自动字幕、语音工具或编辑时间线。例如,当目标是带有自动字幕和简单模板的脚本到视频制作,而不是从头开始的原始电影生成时,Pictory特别有用。Canva AI的“创建视频片段”围绕便利性构建,在一个更广泛的设计工作流程中提供一键生成、电影视觉效果和同步音频。

这个类别现在很重要,因为它降低了制作视频的门槛。你可以用简单的语言勾勒一个想法,快速生成初稿,然后在此基础上进行完善。当摄像团队不现实时,这可以加速原型制作、短格式内容生产、广告概念化、内部演示和视觉叙事。它还降低了技能门槛。你仍然需要判断力、提示技巧和编辑能力,但你不再需要从素材、场景或高级动态软件开始,仅仅是为了视觉化地测试一个想法。

文本到视频AI如何工作:幕后核心流程

从提示解释到场景生成

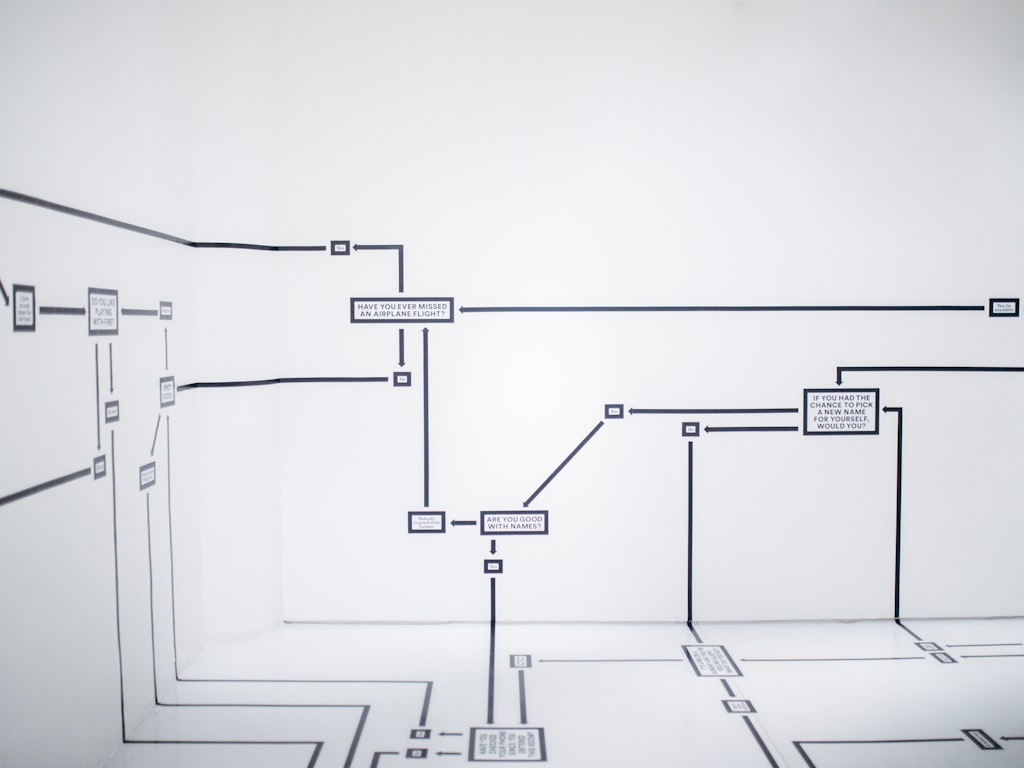

如果你想了解文本到视频AI如何工作的实用模型,可以将其视为一个五阶段的流程:提示输入、模型解释、视觉生成、运动组合和最终渲染。每个阶段都可能根据工具和提示引入清晰或混乱。

首先,你给系统一个提示。该提示可能包括主题、动作、设置、风格和摄像机方向。然后,模型通过将词语和短语映射到对象、环境、关系和视觉属性的内部表示来解释语言。它不是以人类的方式“想象”。它是在预测哪些视觉和运动模式与你提供的指令在统计学上相关联。

接下来是场景生成。系统创建与解释后的提示匹配的视觉内容。在某些工具中,这从噪声开始,并逐渐解析为连贯的帧。在其他工具中,尤其是在图像引导的工作流程中,模型使用参考图像作为锚点,并围绕它生成运动。这是某些模型在一致性方面优于其他模型的原因之一。Zapier的2026年总结称Google的Veo 3.1是最佳的综合AI视频生成器,并特别赞扬了其强大的提示依从性和保持与图像高度一致的能力。当你需要对风格、构图或品牌视觉效果进行更严格控制时,这种组合至关重要。

在场景视觉上存在之后,模型必须解决随时间变化的运动问题。与时间一致性相比,静态图像相对容易。系统必须决定角色如何移动、光线如何变化、摄像机如何移动以及背景如何从一帧到下一帧保持不变而不变形或跳动。这就是许多奇怪的伪影出现的地方:多余的手指、变形的物体、弹性肢体、变化的衣服、不一致的标志或不可能的环境过渡。

最后,该工具将结果渲染成可用的片段。根据产品,你可能还会获得同步音频、字幕、头像或在基础生成之上分层的编辑工具。这就是为什么“AI视频生成器”可以指从纯模型端点到端到端生产应用程序的任何东西。

为什么提示依从性会改变最终结果

提示依从性仅仅是工具遵循你要求的能力,而不是偏离到某种通用内容。如果你的提示是“一个陶瓷马克杯放在木桌上的俯视镜头,早晨的窗户光线,极简主义风格”,一个高度依从的模型应该保留摄像机角度、物体类型、光线和氛围。一个较弱的模型可能会给你一个随机厨房里侧角度的杯子,光线不一致,因为它只抓住了请求的一部分。

这是大多数人在学习文本到视频AI如何工作时容易忽略的部分。输出质量不仅取决于模型有多“智能”。它还取决于它能多么可靠地将你的指令映射到稳定的帧序列中。像“制作一个很酷的未来城市视频”这样模糊的提示留下了太多的空白,所以模型会用默认值来填充它们。这通常会产生乍一看很精致但感觉通用、不一致或与你心中想法联系松散的片段。

一个更好的心智模型是:提示是你压缩成语言的分镜脚本。它越具体、结构越好,模型就越不需要替你发明假设。这并不意味着用形容词塞满每个句子。它意味着给模型正确的锚点,以便它能正确分配视觉注意力。

如何为文本到视频AI编写更好的提示

提高质量的提示元素

提示编写不是噱头。它是一种公认的做法,直接提高输出质量,当前的视频工具对结构的奖励远超人们的预期。如果你想要更好的片段,请明确模型始终需要帮助的部分:主题、动作、摄像机角度、设置、风格、持续时间提示和情绪。

从主题开始。清晰地命名屏幕上的主要事物:“一只红狐狸”、“一个穿着黄色雨衣的女骑手”、“一瓶玻璃瓶装的苏打水”。然后定义动作:“缓慢行走”、“转向摄像机”、“打开瓶子并倒入玻璃杯”。添加设置,让模型知道事情发生在哪里:“在多雾的松树林中”、“在雨夜的东京街头”、“在白色大理石厨房台面上”。

摄像机语言是主要的质量杠杆。诸如“特写”、“广角镜头”、“俯视”、“跟踪镜头”、“缓慢推入”、“手持感”等术语为模型提供了构图方向。风格也很重要:“电影感”、“纪录片”、“动漫风格”、“高对比度商业照明”或“极简主义产品广告”。持续时间提示有助于掌握节奏,即使不能保证精确的时间:“快速社交片段”、“悠长的慢动作瞬间”或“短暂揭示镜头”。情绪完成指令集:“平静”、“紧张”、“俏皮”、“奢华”、“梦幻”。

读者可以重复使用的实用提示公式

一个可重复使用的公式是:

[主题] + [动作] + [设置] + [摄像机] + [风格] + [持续时间/节奏] + [情绪]

这是一个较弱的提示:

“沙滩上的一只狗。”

它很短,但几乎所有内容都未解决。品种、动作、一天中的时间、拍摄类型和情感基调都缺失,因此模型会即兴发挥。

这是一个更强的版本:

“一只金毛猎犬在日落时分穿过浅海,侧面中等跟踪镜头,电影慢动作,温暖的金色光线,欢乐而充满活力的情绪,6秒短片。”

这个版本为模型提供了它可以实际使用的具体锚点。你通常会得到更好的构图、更连贯的动作,以及一个感觉是刻意而非随机的片段。

另一个较弱的提示:

“一个未来城市。”

更强的版本:

“蓝调时刻未来城市的广角航拍,高耸的玻璃塔之间飞行的交通,细微的雾气,湿漉漉的街道上霓虹灯的反射,平滑的无人机式摄像机移动,高细节电影科幻风格,平静而充满敬畏的氛围。”

注意变化:改进的版本缩小了视觉空间。它告诉系统城市应该是什么样子,场景何时发生,存在什么运动,以及摄像机如何表现。这种更清晰的结构改善了指令遵循,并减少了通用填充细节。

如果工具支持负面提示或排除项,请谨慎使用它们:“无文本叠加”、“无额外人物”、“无标志变化”或“避免卡通风格”。这会有所帮助,但最大的收益仍然来自清晰的正面提示。对于大多数工作流程,最佳过程是编写结构化提示,生成一个片段,检查哪里出现了偏差,然后只重写失败的部分。这个循环是提示技巧转化为显著更好的视频质量的关键。

当前最佳文本到视频AI工具及其各自的优势

最佳综合工具

当前市场分为两大阵营:强大的通用生成模型和以工作流程为先、旨在快速制作可用内容的工具。这种区别比任何炒作排名列表都更重要。如果你的首要任务是原始生成质量和更严格的指令遵循,Google的Veo 3.1脱颖而出。Zapier的2026年总结将其描述为市场上最佳的综合AI视频生成器,特别提到了其强大的提示依从性和保持与图像高度一致的能力。这两种品质使其在你的想法与最终片段之间需要一致性,或者你希望围绕源图像生成运动而场景不会偏离太远时特别有用。

当目标是主持人主导或基于头像的沟通,而不是完全电影化的生成时,Synthesia最适合。它在短格式工具比较中被强调为一个强有力的选择,这与许多团队使用它的方式相符:解说、内部培训、销售介绍和谈话式内容,其中速度和清晰度比自由形式的视觉实验更重要。如果你需要在屏幕上出现真人主持人而无需预订人才或设置拍摄,它解决的问题与围绕场景生成的工具不同。

脚本到视频和轻松编辑的最佳选择

当你的原始材料是脚本,并且你想快速将其转化为一个干净的视频时,Pictory是最佳选择之一。它在比较中因其干净的脚本到视频处理、可靠的自动字幕和简单的模板而脱颖而出。这种组合对于短格式教育片段、社交帖子、博客内容再利用和谈话要点视频非常有用,其中可读性和速度比从头开始生成每一帧更重要。自动字幕对于垂直和社交格式来说是一个实用的优势,而模板减少了你需要手动组装的工作量。

Canva AI之所以强大,原因不同:它降低了整个创作过程中的摩擦。Canva表示,其“创建视频片段”可以一键将文本提示转化为AI生成的视频,具有电影视觉效果和同步音频。真正的优势在于集成。你可以在一个熟悉的界面中生成片段、将其与品牌资产结合、添加文本、调整平台大小,并保持所有内容。这使其非常适合快速营销草稿、轻量级宣传内容以及不希望在单独的生成和编辑工具之间切换的设计主导团队。

市场上还有一个有用的模式:一些平台在一个界面中聚合了多个生成器。一个YouTube总结指出,几个AI视频工具可以在一个平台内访问。当你想要比较输出、为不同场景切换模型,或者在测试多个底层引擎时保持一个编辑工作流程时,这很有帮助。如果你的流程依赖于灵活性而不是对单一模型的忠诚度,这些多模型平台可以节省大量时间。

为什么AI视频有时看起来仍然很奇怪

生成视频中常见的故障点

即使是最好的工具,仍然会以非常可识别的方式出现问题。当前的系统可以生成令人印象深刻的片段,但它们并非完全可靠,这就是为什么输出可能看起来不一致、不自然或只与提示部分对齐的原因。初学者解说员经常提到这些限制,你可以在实际使用中立即看到它们:面部微妙变形,手部行为奇怪,镜头中物体数量变化,环境细节从一帧到下一帧漂移。

一个重要原因是时间一致性。单个帧可能看起来很棒,但视频要求同一主题在时间上保持连贯。如果模型失去了这种连续性,衣服会变化,背景物体会滑动,运动看起来在物理上是错误的。另一个问题是指令层次结构。如果你的提示包含太多相互竞争的想法,模型可能会满足一些而忽略另一些。你要求“在昏暗咖啡馆的电影手持特写,咖啡冒着蒸汽,一个人对着镜头轻轻微笑”,结果可能会很好地捕捉到咖啡馆和咖啡,但错过了特写和面部表情。

还有一个更大的未解决挑战:生成一个从头到尾与整个脚本匹配的精致视频。围绕当前工具的研究讨论仍然将其视为一个开放问题,而不是一个已解决的工作流程。这就是为什么一个强大的单个片段不会自动转化为一个完美的90秒序列,其中包含稳定的角色、精确的故事节奏和完成的节奏。

如何排除故障以获得更好的输出

最快的修复方法通常是简化。如果一个提示试图在一个镜头中描述三个动作、两次摄像机移动、多种情绪和一个复杂的环境,请将其分解为场景。一个片段用于建立镜头。一个片段用于动作。一个片段用于反应。当每个生成请求都有一个清晰的任务时,模型的表现会更好。

下一个修复方法是使结构更清晰。如果你的输出感觉通用,你的提示可能缺少锚点。添加摄像机角度、光线、设置和情绪。如果输出感觉混乱,删除多余的描述符,只保留最重要的细节。更好的结果通常来自更短、更清晰的提示,而不是密集的段落。

迭代是不可协商的。将第一次生成视为草稿,而不是最终版本。生成、检查、重写和重新运行。如果模型支持图像引导,当一致性很重要时,请使用源图像。这就是Veo 3.1在实际工作流程中因其与图像高度一致的声誉而如此有用的原因之一。

相应地设定预期。当前的工具擅长概念可视化、短篇氛围片段、产品瞬间、社交内容草稿和快速变体。对于任何必须严格按脚本、品牌完美或在较长时间内叙事一致的内容,它们仍然需要编辑、审查,有时还需要手动拼接。

开源文本到视频AI模型、本地工作流程以及使用前需要检查的事项

开源视频模型何时有意义

如果托管平台感觉受限、昂贵或过于不透明,开源AI视频生成模型可能会非常有意义。当你想要对模型选择、推理设置、定制、隐私或自动化有更多控制时,开源选项非常有用。当你需要一个不依赖于单一公司界面或定价模型的工作流程时,它们也很重要。

搜索诸如开源Transformer视频模型或图像到视频开源模型等术语的人通常试图回答一个实际问题:我能否在不被锁定到托管应用程序的情况下获得强大的生成能力?有时可以,但代价是复杂性。你可能需要管理存储库、模型权重、依赖项、VRAM限制、生成设置和输出管道,而不是在精致的网页仪表板上输入提示。

人们对诸如happyhorse 1.0 AI视频生成模型开源Transformer等非常具体的长尾搜索也越来越好奇。对于小众模型名称,重要的是不要仅仅根据标签来假设其能力。在围绕它构建工作流程之前,请验证该模型是否真正可用、是否积极维护、是否有文档以及是否可在你的硬件环境中运行。

许可、本地运行和图像到视频选项

托管平台和本地工作流程之间的关键区别在于谁处理基础设施。使用托管工具,提供商管理计算、模型更新和渲染管道。如果你想在本地运行AI视频模型,你需要自己处理。这通常意味着在投入之前检查GPU要求、存储需求、安装步骤和生成速度。视频模型可能比图像模型要求高得多,特别是对于更高分辨率或更长的片段。

在选择任何开源模型之前,请仔细验证许可证。搜索开源AI模型商业用途许可证是有原因的。“开源”并不自动意味着不受限制的商业用途。有些模型只允许研究。其他模型允许带有署名或单独条款的商业项目。如果输出将用于客户工作、广告、产品演示或盈利渠道,请直接阅读许可证文本,而不是相信第三方摘要。

还要检查模型是否支持你偏好的输入类型。有些系统主要用于文本到视频,而另一些则作为图像到视频开源模型更强大,当你已经有概念艺术、产品图像或关键帧并希望进行受控运动而不是完全生成的场景时,这可能更有用。图像引导的工作流程通常会产生更一致的结果,因为源帧充当视觉锚点。

最后,请记住,有些平台将多个模型聚合在一个地方。这可能是完全DIY和完全封闭软件之间的最佳平衡点:比较引擎、保持工作流程灵活性,并避免从头开始管理所有内容。对于许多创作者来说,这种混合路径比第一天就完全本地化更实用。

结论

一旦你了解了实际的流程:提示、解释、场景创建、运动和渲染,文本到视频生成就不再那么神秘了。这种心智模型解释了令人印象深刻的结果和奇怪的失败。它也解释了为什么文本到视频AI如何工作实际上是一个关于控制的问题:你如何清晰地描述镜头,模型如何很好地遵循指令,以及工作流程之后需要多少清理工作。

最好的结果通常来自四种习惯。首先,了解工具的实际用途,无论是原始生成、头像、脚本到视频还是集成编辑。其次,编写带有清晰锚点的提示,如主题、动作、设置、摄像机、风格、节奏和情绪。第三,选择与任务匹配的平台:Veo 3.1用于强大的提示依从性和图像保真度,Pictory用于带有字幕和模板的基于脚本的视频,Synthesia用于主持人风格的输出,Canva AI用于在更广泛的设计工作流程中快速一键创建。第四,将输出视为通过迭代改进的快速草稿。

这是在实践中理解文本到视频AI如何工作最有用的方法。这些工具已经足够好,可以加速生产并快速解锁想法,但它们仍然奖励精确性、测试和编辑。当你与流程协同工作而不是对抗它时,结果会变得更加可预测——也更加可用。